目录导读

- AI 伦理治理的紧迫性与挑战

- Sefaw 技术框架解析:核心功能与应用场景

- Sefaw 如何赋能 AI 伦理治理:四大关键路径

- 实践案例:Sefaw 在数据隐私与算法公平中的应用

- 争议与局限:技术辅助治理的边界探讨

- 未来展望:构建人机协同的伦理治理生态

- 问答:Sefaw 与 AI 伦理的常见疑问

AI 伦理治理的紧迫性与挑战

随着人工智能技术的快速发展,伦理治理已成为全球关注的焦点,AI 系统在医疗、金融、司法等领域的广泛应用,引发了数据隐私、算法偏见、责任归属等伦理问题,传统治理模式依赖法律规范和行业自律,但面对动态演进的 AI 技术,往往显得滞后且乏力,算法黑箱问题导致决策过程不透明,加剧了社会对公平性的担忧,在此背景下,寻求技术辅助的治理工具成为必然趋势,而 Sefaw 作为一种新兴的技术框架,正被探索其在伦理治理中的潜在价值。

Sefaw 技术框架解析:核心功能与应用场景

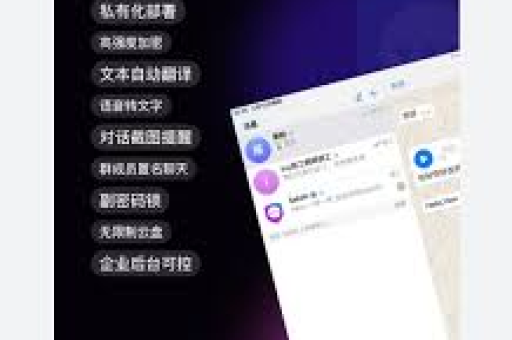

Sefaw(可解释性安全框架)是一种结合了可解释人工智能(XAI)与动态风险评估的技术体系,其核心功能包括:

- 实时监测与审计:通过嵌入式的监测模块,追踪 AI 系统的决策逻辑和数据流向,识别潜在伦理风险(如歧视性偏差)。

- 透明度增强:将复杂的算法过程转化为可理解的视觉化报告,帮助非技术人员理解 AI 的决策依据。

- 合规性自动化:根据预设的伦理准则(如 GDPR、AI 伦理原则)自动检测系统合规性,生成修正建议。

Sefaw 已初步应用于金融风控和医疗诊断领域,例如在信贷审批中减少性别或种族偏见,或在辅助诊断中确保患者数据的安全处理。

Sefaw 如何赋能 AI 伦理治理:四大关键路径

提升算法透明度

Sefaw 通过可解释性模型,将“黑箱”决策转化为逻辑链,使开发者、监管者甚至用户能够追溯 AI 的推理过程,在招聘 AI 中,Sefaw 可揭示简历筛选的权重分配,避免隐含偏见。

动态风险预警

传统伦理审计多为事后干预,而 Sefaw 可实时监控数据输入和输出偏差,当系统出现非常规决策模式时(如突然拒绝某类人群的贷款申请),自动触发警报并记录异常。

促进多方协同治理

Sefaw 提供标准化数据接口,允许企业、监管机构和第三方审计方共享风险数据,形成协同治理网络,欧盟的 AI 法案试点项目中,已尝试利用类似框架进行跨境合规验证。

降低治理成本

自动化伦理检测减少了人工审计的耗时与主观性,研究显示,采用 Sefaw 类工具的企业,其算法合规评估效率提升约 40%,尤其利于资源有限的中小企业。

实践案例:Sefaw 在数据隐私与算法公平中的应用

- 医疗数据隐私保护:某欧洲医院使用 Sefaw 框架管理 AI 诊断系统,通过加密数据流分析和访问日志追踪,系统在三年内未发生数据泄露事件,同时确保诊断模型符合《赫尔辛基宣言》的伦理要求。

- 司法算法去偏见化:美国某州法院引入 Sefaw 评估累犯预测 AI,框架通过对比不同族裔群体的风险评分分布,发现算法对少数族裔的误差率高 15%,技术团队据此调整训练数据,将偏差率降至 3% 以内。

争议与局限:技术辅助治理的边界探讨

尽管 Sefaw 展现出潜力,但其局限性仍引发争议:

- 技术依赖风险:过度依赖工具可能导致“伦理外包”,削弱人类主体的责任意识,企业可能将 Sefaw 的合规报告视为“伦理免罪牌”,忽视深层价值观反思。

- 框架普适性不足:不同文化对伦理的定义存在差异(如东方集体主义与西方个人主义),Sefaw 的通用规则库可能无法覆盖区域性伦理需求。

- 安全与滥用的悖论:Sefaw 自身若被恶意操纵,可能成为掩盖伦理问题的工具,专家呼吁需建立针对治理工具的“元监管”机制。

未来展望:构建人机协同的伦理治理生态

理想的 AI 伦理治理需融合技术工具与人文思考,未来发展方向包括:

- 开发自适应伦理引擎:让 Sefaw 能够结合场景动态调整伦理权重,例如在自动驾驶的“电车难题”中平衡法律与道德参数。

- 推动全球标准共建:通过开源社区(如 OpenAI 的治理倡议)促进 Sefaw 框架的国际化改进,避免技术霸权。

- 强化教育协同:在高校课程中引入“伦理技术工具”培训,培养既懂伦理又懂技术的复合型治理人才。

问答:Sefaw 与 AI 伦理的常见疑问

问:Sefaw 能否完全替代人类在伦理治理中的角色?

答:不能,Sefaw 是辅助工具,而非决策主体,它擅长处理结构化伦理问题(如数据合规),但无法替代人类对复杂价值冲突的判断(如 AI 在战争中的使用边界),人机协同才是可持续路径。

问:中小企业如何低成本应用 Sefaw?

答:开源版本的 Sefaw 框架(如 IBM 的 AI Fairness 360)已提供基础功能,云计算服务商正推出模块化伦理工具包,企业可按需订阅监测服务,降低部署成本。

问:Sefaw 会否拖慢 AI 创新速度?

答:短期可能增加开发环节,但长期看,通过前置伦理风险防控,可避免产品上市后的法律纠纷与声誉损失,欧盟调查显示,采用伦理工具的企业,其 AI 项目长期成功率提高 30%。

问:如何确保 Sefaw 自身的伦理中立性?

答:需通过多元团队参与开发(包括伦理学家、社会学家),并引入第三方审计,类似“算法影响评估”的认证制度正在探索中,以杜绝工具设计者的隐性偏见。